エージェント型AIの時代における決心の支配性 (Small Wars Journal)

MILTERMでは人口知能(AI)に関わる投稿をこれまでもしてきている。AIに何を期待するのか、倫理上の課題は克服できるのかなどといった議論も紹介してきている。人間の行っていることをそのままAIに肩代わりさせるのが良いのか、あるいはAIだからこそできることがあるので、既存のやり方ではなくAIに適合したやり方を作り出していこうとする考えがある。軍事における意思決定にAIを使用することの議論は、倫理的な面を含めてまだまだ解決していかなければならないことがあるように思われる。まずはAIを使いながら考え、その中で出てきた課題を解決していくこともその一つだろう。そんな中で、軍事においては単純に人のやっているプロセスをAIに置き換えるというのは、あまりにも安直なAIの活用方法ではないのだろうかとも考えてしまう。しかし、人間が手に負えない状況を作り出すのも、また、考えものであるだろう。数多くある議論の中の一つとしてご一読いただきたい。(軍治)

![]()

エージェント型AIの時代における決心の支配性

Decision dominance in the Age of Agentic AI

by John Herrman

10.03.2025

ジョン・ハーマン(John Herrman)は、作戦の計画策定と意思決定における決心の支配性(decision dominance)のためのエージェント型AIソリューションを開発する防衛技術企業、エクシア・ラボの共同設立者である。退役した米陸軍大佐で、29年にわたり大隊や旅団レベルで指揮を執り、中米地域司令部(CENTCOM AOR)での作戦支援に従事した。最終任務は第18空挺軍団の民亊担当(G5)で、在任中、複数の作戦計画策定を指揮した。

|

はじめに

一秒一秒が勝利と破局を分けるカミソリの刃のような戦場での指揮官を想像してみてほしい。たった一度の決断の遅れ、一歩の踏み間違いによって、人命が失われ、任務は崩壊し、戦争は転換する。これが決心の支配性(decision dominance)であり、敵よりも速く理解し、決断し、行動する力である。データが弾丸よりも速く移動する今日の紛争では、決心の支配性(decision dominance)が生存を左右する。中国やロシアのような国々は、AIやリアルタイム・ネットワークに何十億ドルもの資金を投入し、米国を凌駕するために、この技術を習得しようと競い合っている。

国防総省はこの現実を認識している。国防総省は2023年「データ・分析・人工知能適用戦略(Data, Analytics, and Artificial Intelligence Adoption Strategy)」の中で、「指揮官の意思決定のスピードを加速し、意思決定の質と精度を向上させる」ためにはAIの統合が不可欠であると強調している。このコミットメントを反映して、国防総省は2025会計年度にAIプログラムに18億ドルを割り当てており、AIを活用した意思決定に戦略的な優先順位が置かれていることを強調している。この大規模な投資は、従来の意思決定支援システムからエージェント型AI(Agentic AI)、つまり単に情報を提供するだけでなく、指揮・統制ワークフローの中で能動的に感知し、推論し、行動するシステムへのシフトを示唆している。

静的なダッシュボードや予測モデルとは異なり、これらのシステムはライブの作戦データを継続的に解釈し、複数のドメインを調整し、リアルタイムで行動方針(courses of action)を生成する。この違いは重要である。今日、「AI」の烙印を押されている多くのツールは、洗練された検索エンジンや要約を提供する生成モデルに過ぎず、真に自律的で目標指向のエージェントにはほど遠い。これらのツールは、第一次世界大戦における初期の機械化に相当する。軍隊が馬車の荷台に機関銃をボルトで固定したり、トラックに装甲を縛り付けて「装甲(armor)」と称したりしたのは、真の機動戦(true maneuver warfare)にはほど遠い段階的なステップだった。これとは対照的に、エージェント型AIは電撃的な飛躍(blitzkrieg leap)を意味する。センサー、情報、用兵機能(warfighting functions)、評価と作戦をフィードバック・ループとして融合させた統合型適応システムである。これにより、紛争のスピードに合わせて動くダイナミックな意思決定支援システムが構築される。

統合全ドメイン指揮・統制(JADC2)戦略が強調しているように、「関連性のスピードで情報の優位性」を達成するには、まさにこの種のAIを活用した敏捷性が必要である。歴史を振り返ってみると、破壊的な技術への対応において、軍隊はしばしば分裂する。ある軍隊はドクトリンを適応させ、それをフルに活用するが、ある軍隊は過去の方法に固執し、敵対者が明日の準備をしている間に昨日の問題を解決する。

1940年、フランス軍は世界最高峰の軍隊であり、武装し、要塞化された戦線に潜り込んでいた。しかし、6週間でドイツ国防軍に粉砕された。なぜか?フランス軍は古い戦術に縛られ、静的な防御と鈍重な運び屋に固執していた。対照的に、ドイツ軍は部隊の「リーダーシップ(Truppenführung)」でドクトリンを書き直し、当時の最先端技術-FMラジオ-を利用するようにデザインされた部隊を構築した。このシンプルだが画期的なツールによって、分散していた戦車、歩兵、航空機が、フランス軍の追随を許さないテンポで通信し、同期することが可能になった。指揮官たちは初めて、複数の領域にわたる作戦をリアルタイムで調整し、真の作戦術(operational art)を実践できるようになった。彼らは混乱を勝利に変え、フランス軍を動揺させる決心の支配性(decision dominance)を達成した。

今日、選択肢は同様である。軍隊は実際のデータ(live data)とエージェント型AI(Agentic AI)を受け入れ、未来の戦争を闘うためにドクトリンと実践を再構築するか、あるいは過去の問題を解決するためにレガシーな手法に固執し続けることができる。1940年にFMラジオが作戦術(operational art)を解き放ったように、エージェント型AIは今日、「決心中心の戦い(decision-centric warfare)」を解き放つ可能性を秘めている。問題は、ドクトリンと習慣がそれをつかむために適応するかどうかである。

障害と永遠の課題

しかし、この飛躍には、文化的にも技術的にも障害がないわけではない。エージェント・システムを職員のプロセスに組み込むには、組織の抵抗や凝り固まった習慣を克服する必要がある。歴史を振り返ってみると、軍隊はレガシーな手法を捨て去るのに苦労することが多く、AIの導入も例外ではない。AIがナポレオン時代の参謀モデルそのものをどのように再構築するかについては多くのことが書かれており、軍事意思決定プロセス(MDMP)のような意思決定プロセスが根本的に異なるものに進化する可能性が提起されている。しかし、より大きな問題は信頼の問題である。命が危険にさらされているときに、指揮官や参謀はAIが生成した仮定、行動方針(courses of action)、勧告を受け入れるだろうか?最も洗練されたシステムであっても、人間の指導者がそれを使うことをためらえば、メリットを与えることはできない。

しかし、より大きな問題は信頼の問題である。人命が危険にさらされているときに、指揮官や参謀はAIが生成した仮定、行動方針(courses of action)、勧告を受け入れるだろうか?

さらに複雑なのは、いわゆる「AI」ツールが乱立していることだ。人工知能として販売されている多くのシステムは、実際には、検索を強化した世代モデルや静的なダッシュボードを自律性の言葉で包んだものに過ぎない。このような模倣品は作戦環境にノイズをもたらし、指揮官や参謀を、どのAIシステムもその約束を本当に果たせるのかどうか疑心暗鬼に陥らせる。誇張された主張が実際に失敗すると、AIという広範なコンセプトに対する信頼が損なわれ、たとえ本物の能力を提供する場合でも、指導者たちはエージェント型システムの採用をためらうようになる。危険なのは、技術的な混乱だけでなく、制度的な懐疑心である。したがって、エージェント型AIが模倣品と区別され、計画策定や作戦のパートナーとして信頼されるためには、明確な定義、厳格な評価、実証された実績が不可欠である。

文化だけでなく、技術的な統合にも課題がある。レガシー・プラットフォーム、秘密区分の障壁、競合する標準規格が情報の流れを複雑にするため、サービス、階層、セキュリティ・ドメインを超えてエージェント・システムを接続することは摩擦をもたらす。同時に、AIへの依存は独自の摩擦をもたらす。これは一種の「デジタルの戦争の霧(digital fog of war)」となる。敵対者は、この新しい意思決定方法を悪用しようとするだろう。彼らはAIが依存する情報源を欺いたり、偽のデータを注入したり、腐敗させようとするだろう。課題は、単にインテリジェントなシステムを構築することではなく、操作(manipulation)に対する耐性を確保することなのだ。

しかし、最も難しい課題は、システムを構築することではなく、その成果に基づいて行動するよう指導者を説得することである。このためらいは今に始まったことではない。何世紀にもわたり、指揮官や参謀たちは、「戦争の霧(fog of war)」の中でいかに明瞭に視界を確保し、不確実性があるにもかかわらず自信を持って決断を下すかについて格闘してきた。カール・フォン・クラウゼヴィッツは、1832年に発表した傑作『戦争論(On War)』の中で、この不朽の問題をとらえ、混乱や摩擦の中にあっても、一目で状況の決定的な要素を見極める指揮官の「内なる目(inner eye)」である「一瞥(coup d’œil:クー・ドーユ)」について述べている。彼は、この能力がなければ、計画は圧力によって崩壊すると警告した。なぜなら明瞭さはすべての決定的な行動の基盤であるからである。

これらの障壁は、エージェント型AIの有望性を減じるものではない。むしろ、AIを破壊的なアウトサイダーとしてではなく、信頼できるパートナーとして位置づけるには、文化的な変革、確実な統合、そしてドクトリンを伴う必要があることを浮き彫りにしている。これらのハードルを乗り越えるには、技術的な解決策だけでなく、訓練、実験、組織改革も必要になる。これらはすべて、指揮官や参謀が疑念を抱くのではなく、自信を持ってAIのアウトプットを信頼できるようにするためのステップである。その見返りは大きい。指揮の中心であり続ける信頼と判断を犠牲にすることなく、エージェント・システムのスピードと適応性を活用できる軍隊だ。

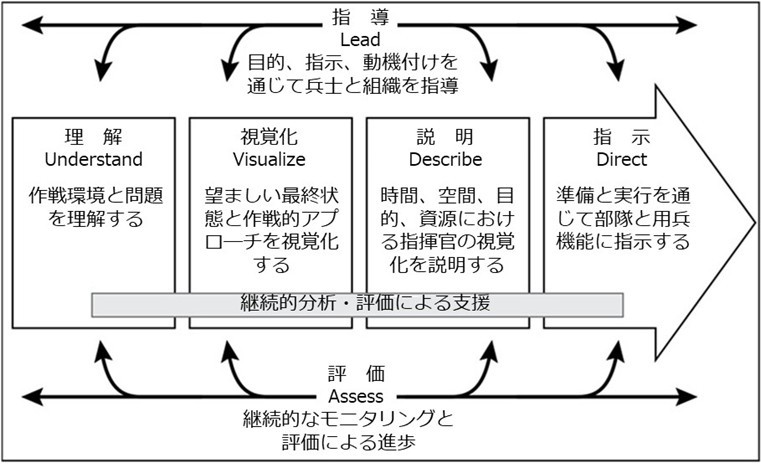

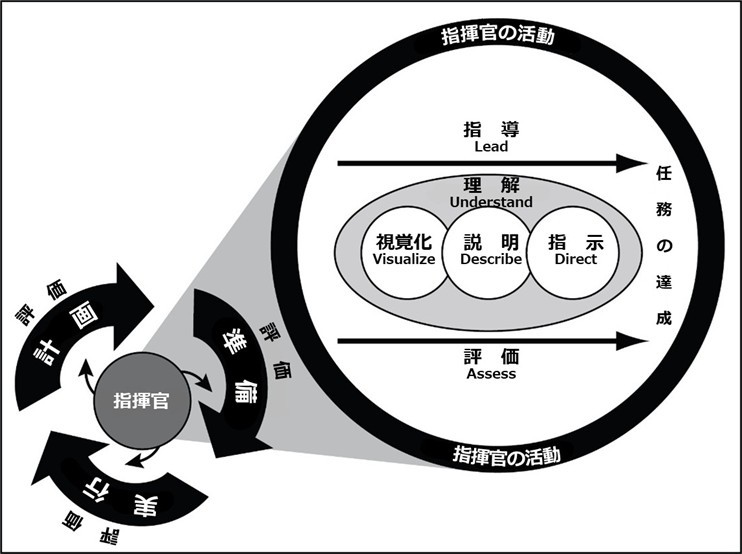

この意味で、今日の指揮官や参謀が直面している問題は、技術というよりも、明晰さと判断力に関するものである。エージェント型AIは、「一瞥(coup d’œil)」の延長として理解することができる。人間の直感(human intuition)に取って代わることなく、生の作戦データを感知し、解釈し、理解を早める形で提示するツールである。クラウゼヴィッツが指揮官の最も重要なことを把握する能力を強調したのに対し、AIはその能力をより大きく、より速く、より複雑な情報の流れに拡大することができる。この枠組みは、陸軍の指揮のドクトリン上のステップ(理解(understand)、視覚化(visualize)、(描写(describe))、指示(direct)、(指導(lead))、評価(assess))と直接的に一致する。各要素は、「一瞥(coup d’œil)」の現代的体現を反映している。信頼とは、直感(intuition)を機械に置き換えることではなく、人間の直感(human intuition)をAIが可能にした知覚と融合させることで、意思決定サイクルのあらゆる段階で、より鋭く、より弾力的な「一瞥(coup d’œil)」を実現することから生まれる。

参考:作戦プロセスにおける指揮官の役割(FM 5-0 Army planning and orders production) |

参考:作戦プロセス(FM 6-0 Commander And Staff Organization And Operations) |

この歴史的なレンズを通して、以下のセクションでは、古典的な指揮の原則と組み合わされた近代的なツールが、実際にどのように決心の支配性(decision dominance)を生み出すことができるかを説明する。以下のストーリーは、複雑な作戦環境で敵対者に打ち勝つために、明晰さ、視覚化、断固とした行動、そして継続的な評価が、技術によってどのように強化され得るかを、指揮官の実体験から引き出されたものである。

理解する – 行動する前に明確にする

クラウゼヴィッツは「一瞥(coup d’œil)」を「不確実性の先を明確に見通す能力(the ability to see clearly through uncertainty)」-現代の作戦を理解するための第一歩となるスキル-と表現した。2022年1月、ウクライナで危機が迫っていたときの計画策定の間、第18空挺団はその明瞭さがいかにもろいものであるかに直面した。ロシアのウクライナ侵攻が迫るなか、非戦闘員の避難作戦を計画策定するタスクを負ったチームは、避難民と飛来するC-17の一時的な安全地帯となる飛行場がポーランドに必要だった。ポーランドが長年NATOの同盟国であったことから、滑走路の仕様、燃料容量、インフラなど、重要な詳細は米欧州軍からすぐに入手できると思われていた。しかし、そうではなかった。

その代わり、計画策定チームは紙の地図に候補地を丸で囲み、散在する資料を一日かけて調べ、どの場所が実現可能かを判断していた。そのような努力の後でも、指導者を派遣して各現場を実際に偵察することに代わるものはなかった。知識と理解のギャップは、作戦開始前に頓挫するところだった。クラウゼヴィッツの洞察力をまざまざと見せつけられた思いである。指揮官は又聞きの報告や仮定に頼ることはできず、一目で決定的な要素を見分けるための環境把握、すなわち「一瞥(coup d’œil)」を培わなければならない。

より広範な教訓も同様に重要である。上層部が必要なものをすべて提供してくれると考えるのは間違いである。今日、情報には事欠かないが、その量は圧倒的であり、関連する詳細を時間内に特定することが真の課題である。指導者は通常、下すべき決断と必要な情報を知っているが、手動のプロセスを通じてその情報を検索して、検証するには貴重な時間がかかる。戦争において、時間は無駄にできない商品である。

かつては手間のかかる偵察が必要だったものが、数秒に短縮され、現代の紛争に必要なスピードで理解できるようになった。

エージェント型AIは変革の可能性を秘めている。実器材のレーダーからのフィード、オープンソース・データ、ソーシャル・メディア・ストリーム、兵站データベース、その他の情報源を融合させることで、エージェント・システムは、ポーランドの飛行場の滑走路状況、処理能力、インフラ状況を、何週間も遅れることなく即座に明らかにすることができた。かつては骨の折れる偵察が必要だったものが数秒に短縮され、現代の紛争に必要なスピードで状況を把握できるようになったのだ。敵よりも速く理解する能力は、決心の支配性(decision dominance)への第一歩である。

視覚化する – 最初の一手を打つ前に最終状態を見る

環境を理解することは最初のステップに過ぎない。指揮官はまた、戦闘を視覚化し、最初の一手を打つ前に、複雑さを断ち切って最終状態を想像しなければならない。このステップにはしばしば時間と内省が必要だが、現代の戦争では時間がない。エージェント型AIは、膨大な量のデータを処理し、推奨事項を提示し、仮定をテストすることで、可視化をより速く、より明確に実現し、計画策定を加速させ、決心の支配性(decision dominance)を達成することができる。

1918年9月、ジョージ・C・マーシャル(George C. Marshall)大佐は、第一次世界大戦を終結させるための一か八かの作戦であったムーズ・アルゴンヌ攻勢で、この難題に直面した。米国遠征軍(AEF)の計画担当官(G5)として、その任務は、60万の兵力、3000の砲兵器、9万の馬、100万トンの物資を、ドイツ軍に警戒させることなく、2週間で50マイル移動させるという途方もないものであった。圧倒され、彼はその場を離れた。フランスの運河のほとりに座り、年配の漁師が釣り糸を垂れているのを眺めていた。30分ほど沈黙が続いた。道路網、夜間行軍のリズム、フランスの同盟国との連携など、物流の傑作が形作られ始めた。彼はデスクに戻り、ビジョンを計画に変え、米国遠征軍(AEF)を発見されずに移動させ、勝利への舞台を整えた。歴史家のエドワード・G・レンゲル(Edward G. Lengel)は、これをターニング・ポイントと呼んでいる。

マーシャル(Marshall)の運河側のビジョンは、プレッシャーの中でじっくりと集中することがいかに明晰さを引き出すかを示しているが、同時に洞察に到達するのに必要な時間も浮き彫りにしている。今日、エージェント・システムはそのプロセスを圧縮し、何時間もの熟考をほぼリアルタイムで可視化することができる。選択肢を提示し、仮定をストレス・テストし、指揮官や参謀がより早く最終的な状態を確認できるようにすることで、エージェント型AIは計画策定サイクルを加速させ、指導者に敵よりも早く可視化し、決心の支配性(decision dominance)を握る能力を与える。

指示する – 洞察から行動へ

指示する(directing)とは、洞察力を行動に移すことである。決断を下すこと、プレッシャーの中で適応すること、可能性を結果に変えることである。視覚化(visualization)は選択肢を特定するのに役立つが、指示する(directing)は理解を結果に変える。

2023年3月、スーダンでの非戦闘活動中、ハルツーム唯一の空港が封鎖され、数百人の米国人が早急な避難を求められた。何日もの間、従来のあらゆる選択肢は実現不可能であり、結果は不可能に思えた。すると、ある記憶が浮かび上がった。友人が『飛行機、電車、自動車(Planes, Trains, and Automobiles)』について笑っていたとき、ジョン・キャンディ(John Candy)との気まずい瞬間のあと、スティーブ・マーティン(Steve Martin)が「それって枕じゃないよ!(Those aren’t pillows!)」と叫んでいた。飛行機はダメだが、電車やバス、船なら使えるかもしれない。契約チームはこれらの代替案を検討するよう指示された。「列車の切符を調べ、バスをチャーターし、海岸沿いのルートを探せ」。ハルツームから港へのノンストップ・バスが確保され、サウジアラビアへの船が続いた。きれいなものではなかったが、何百人もの命を救うことができた。

教訓:指示する(directing)とは、たとえ不可能と思われる状況であっても、チャンスをつかみ、ひらめきを行動に移すことである。エージェント型AIはこのプロセスを変えることができる。人間の記憶や即興(improvisation)だけに頼るのではなく、AIが生きた輸送データを迅速に照会し、実行可能な複数のルートを生成し、実行可能な選択肢を数秒で提示することができる。かつては直感(intuition)と粘り強さが必要だったことが、より速く、より明瞭に、より確信を持って達成できるようになり、洞察の閃きを協調的で決定的な行動に変えることができる。

評価 – 継続的評価

指示する(directing)ことで計画は動き出すが、フォローアップのない実行は不完全である。評価(assessment)は、計画が確実に実行されるようにするものである。それは一過性のものではなく、行動を評価し、ギャップを発見し、誰も文句を言わないときでも改善するという絶え間ないサイクルである。

この教訓は2017年、イラクとシリアでの対ISIS作戦でさらに強まった。この作戦を支援する高機動砲兵ロケット・システム(HIMARS)大隊は数週間にわたって活動していた。高機動砲兵ロケット・システム(HIMARS)の打撃は成功しているように見えた。しかし、戦場を回った後の司令官の観察によると、すべての打撃が成功しているという前提に疑問が生じた。部隊はすべての打撃について、戦闘被害評価(BDA)プロセスを通じて継続的な評価を実施し始めた。これらの評価で問題が発覚した。ある地域からのロケットが5~10メートルずれていたのだ。

効果を得るには十分な距離だが、市街地では5メートルから10メートルでは壊滅的な打撃を受ける可能性がある。調査の結果、先進野戦砲兵戦術データ・システム(AFATDS)に欠陥があることが判明した。先進野戦砲兵戦術データ・システム(AFATDS)は、高機動砲兵ロケット・システム(HIMARS)ランチャーが使用する標高-平均海面-ではなく、ターゲットの標高を楕円体からの高さにデフォルト設定しているのだ。この違いによって標高計算に誤差が生じ、最終的にロケットが5~10メートルもずれてしまった。誰も文句を言わなかったが、積極的な評価によって誤差が特定され、修正が可能になり、精度が回復した。評価(assessment)は形式的なものではなく、目に見えないリスクに対する安全策だった。

今日、エージェント型AIはこのような評価(assessment)を継続的に行うことができ、ライブ戦闘被害評価(BDA)フィードやオペレーション・データを分析し、異常を浮き彫りにし、行動可能な洞察(insights)をリアルタイムで提供することができる。指揮官は、次のバトル・リズム・イベントや意思決定ボードを待つ代わりに、方針を修正し、リスクを軽減し、決心の支配性(decision dominance)を維持するために即座に行動することができる。評価は継続的で、適応性があり、人間だけよりもはるかに速い。

結論 – エージェント型AIと決心の支配性の未来

将来における決心の支配性(decision dominance)は、理解、視覚化、指示、評価のサイクルを敵よりも速いテンポで実行できるかどうかにかかっている。ウクライナ、ムーズ・アルゴンヌ、スーダン、そしてISISとの闘いでのエピソードはすべて、これらの各ステップ-行動前の明確さ、プレッシャー下での視覚、決定的な指示、そして絶え間ない評価-がいかにもろく決定的なものであるかを強調している。今日変化しているのは、サイクルの重要性ではなく、それを実行に移すスピードである。敵対者はすでにAIやデジタル・ネットワークを駆使して、自らの意思決定プロセスを加速させ、タイムラインを短縮し、利害関係を高めている。優位性を維持するためには、指揮官と参謀は、サイクルの各ステップをより速く、より明確に、そして参謀だけでは対応できない規模で実現するパートナーとして、エージェント型AIを統合しなければならない。

エージェント型AIは、生きたデータを継続的に統合し、リアルタイムで結果を分析し、実行可能な選択肢を提示することができる。これらのシステムは、理解を加速させ、視覚化を圧縮し、指針(guidance)のスピードと精度を高め、評価を周期的ではなく持続的に行うことができる。決心の支配性(decision dominance)は、もはや指揮官の単なる直感(intuition)の域を出ない。自律的で適応性のある知性(intelligence)の力を借りれば、それは持続的な作戦能力となりうる。しかし、この可能性を実現するには、ワークフローにAIを追加するだけでは不十分だ。

解決策は、文化的、技術的、制度的な課題に共に取り組むことにある。信頼と採用という文化的障壁に対しては、指導者は、エージェント・システムを謎めいたブラック・ボックスではなく、参謀のチームメイトとして扱う訓練、教育、ウォーゲームを通じて、AIを正常化しなければならない。統合の技術的障壁については、システムをテストし、レッド・チームを編成し、ドメインと秘密区分レベル全体での相互運用性のためにデザインする必要があり、最初から欺瞞(deception)や操作(manipulation)に対する耐性が組み込まれている必要がある。また、模倣品という課題に対しては、国防総省は、信頼性が失われる前に、明確な基準、厳格な評価プロセス、真の能力と誇大広告を区別する透明性の高い実証を確立しなければならない。

実際には、これはドクトリンの適応、さらには再編成を意味し、過去の世代が野戦砲兵将校、インテリジェンス分析官、あるいは兵站担当者を統合したように、エージェント型AIを意思決定チームの責任あるメンバーとして参謀に組み込むことを意味する。そうすることで、組織は不信感を克服し、その使用に規律を徹底させ、指揮官や参謀がAIを脅威としてではなく、戦力増強剤として見るようにすることができる。その見返りは、より速く、より鋭く、より適応性の高い意思決定プロセスであり、その中核にある人間の判断を犠牲にすることなく、決心の支配性(decision dominance)を可能にする。

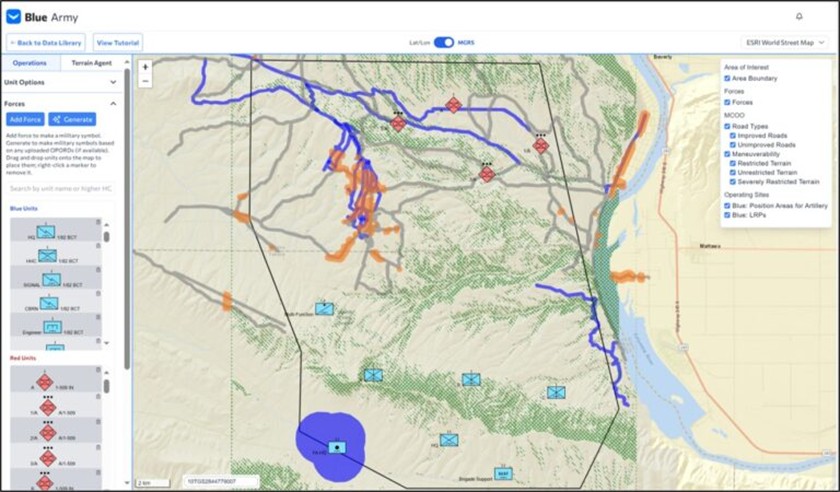

Exia LabsのBlue(写真)やReconといった製品は、エージェント型AI(Agentic AI)を活用して複雑な作戦環境を理解し、その理解を深め、実行可能な推奨事項を含む行動方針を生成することで、戦闘員を支援する。この次世代の計画策定技術は、理解と意思決定を加速する。 |

すでに一握りの企業が、真のエージェント型AIのフロンティアを押し広げ、適応型エージェントを構築し、ゲーム技術の進歩を活用してその機能を強化し、「AI」として流布されがちな検索補強型世代システムをはるかに超えている。これらの取り組みは、革新(innovation)に成長の余地が与えられれば、作戦の計画策定と実行の未来がどのようなものになるかを指し示している。米国代表にとって必要なのは、派手なマーケティングや誇張された統計、ベンチャー・キャピタルの光沢を持つ組織ではなく、こうしたパイオニアを特定し、それに関与することである。真のブレークスルーは、過去の問題のためのツールの再パッケージ化ではなく、明日の戦争のためのシステムをデザインする人々から生まれるだろう。

その教訓は明確だ。戦いの未来は、計画策定と実行の各段階にエージェント型AIを意図的に組み込むことを要求する。この技術を採用する国は、より迅速に行動し、より正確に結果を予測し、従来の方法では及ばない方法で主導権を握る能力を得るだろう。エージェント型AIは遠い可能性ではなく、すでに到来している。文化的、組織的に適応しながら、今すぐ行動する者が先にAIを使いこなし、決心の支配性(decision dominance)を確保することができる。