会戦のための頭脳 (European Security & Defence)

ロシア・ウクライナ戦争における衛星情報の活用やドローンを使用した目標の探知や攻撃などに関して人工知能の軍事分野における使用例が報道されるなど、徐々に人工知能が適用されつつあると考えていいのだろう。一方で人間の判断を介さない殺傷兵器への人工知能適用については、議論が始まったばかりと言ってよいのではないだろうか。

工知能の軍事分野の適用に関する制限等の結論が出るまで待ち、そしてその後に人工知能活用とそのための整備について考えればよいなどとは言ってられない。人工知能を軍事に適用するとはどういうことなのか。どのような適用場面があるのか。適用される人工知能の技術的側面はどうなっているのか。そもそも人工知能の今の出来ること、そして近い将来可能となることは何なのか。等々、議論をするにしても人工知能についての知識が必要となるし、また、その内容はあまりにも専門的なものになるのだろう。

MILTERMでは、人工知能に関する記事を2018年以降掲載してきている。ここで紹介するのは、European Security & Defenceに掲載された人工知能を戦術レベルの指揮・統制に適用することに関する内容である。(軍治)

![]()

会戦のための頭脳

A brain for battle

Thomas Withington

European Security & Defence

21 June 2024

トーマス・ウィジントン(Thomas Withington)はフランスを拠点とする電子戦、レーダー、軍事通信の独立系のスペシャリスト。

*******************

人工知能技術は、リスクとリターンの両方をもたらす戦術的戦闘管理システムに徐々に採用されつつある。

今後、軍隊が戦術レベルで処理することが期待されるデータ量には、段階的な変化が予想される。AIはこの膨大な情報を照合するのに役立つと期待されている。 写真:GlobalMil社 |

2019年3月、ザカリー・デイヴィス(Zachary Davis)博士は「戦場における人工知能:抑止力、安定性、戦略的奇襲への潜在的影響に関する初期調査(Artificial Intelligence on the Battlefield: An Initial Survey of Potential Implications for Deterrence, Stability, and Strategic Surprise)」と題する論文を発表した。デイビス(Davis)博士は、カリフォルニア州にあるローレンス・リバモア国立研究所(LLNL)のグローバル・セキュリティ研究センターの上級研究員である。また、同州にある米海軍の海軍大学院の研究教授でもある。

デイビス(Davis)は論文の冒頭で人工知能(AI)の定義を述べ、それを「ビッグ・データ(big data)」を利用するコンピュータの活用に関連する現象の緩やかな集合体であると説明した。そして、AIを「パターン認識ソフトウェアの基礎となるアルゴリズム」と簡潔かつ有用に定義している。これらのアルゴリズムは、「高性能コンピューティング・パワー(high performance computing power)」と組み合わされる。この収束(convergence)によって、データ・サイエンティストは「膨大なデータ・コレクションを調査し、意味を見出す」ことができる。

人工知能、機械学習、そして戦術的指揮・統制

戦術的な戦闘管理システム(BMS)にAIのアプローチを取り入れる魅力とはなんだろうか?インターネット・ガバナンス・ラボの博士研究員であり、ワシントンDCにあるアメリカン大学の安全保障イノベーション・新技術センターのリサーチ・アソシエイトでもあるイアン・レイノルズ(Ian Reynolds)博士は、「少なくとも米国の文脈では、重要な目標になりつつある「決心の優位性/支配性(decision advantage/dominance)」の概念の達成に貢献することが目標だ」と語る。このようなシステムは、膨大な量の関連データを活用することで、行動指針(courses of action)の作成、パターンの解明(uncover patterns)、敵対者の振舞い(adversary behaviour)が確立されたパターンから逸脱した場合の特定、「センサーからシューターまで(sensor to shooter)」のタイムラインの短縮に役立つだろう。

デイビス(Davis)は論文の中で、「戦争の作戦的レベルでのAIの適用は、戦術的目標を達成するための汎用目的軍事部隊(general-purpose military forces)の使用に非常に大きな影響を与える可能性がある」と主張した。EpiSci社のオートノミー製品担当ディレクターであるパトリック・’クラウン’・キリングスワース(Patrick ‘Krown’ Killingsworth)は、「EpiSciでは、我々のAIシステムが(戦闘管理、指揮・統制ドメインにおける)人間の意思決定プロセスを補強すると考えています。戦いのあらゆるレベルにおいて、到達目標は人間の認知作業負荷(human cognitive workload)を軽減することです」。

「戦術的レベルでは、この情報は指揮官の知識と経験を補強するもので、AIを使って潜在的な行動方針(courses of action)を生成したり、部隊の現状から予想される結果を表示したりすることができる」とキリングワース(Killingsworth)は続けた。システマティック社の陸上戦略担当ディレクター、ヘンリック・ゾンマー(Henrik Sommer)は、「AI技術を活用することで、計画や命令の策定や作成を迅速化できる」と語る。起草プロセスを加速させることは、民間の世界ではAIに対してますます受け入れられていることである。プレス・リリースの起草から、スマーフに関するコメディ・カントリー&ウエスタンの歌詞の作成まで、AIを基盤とするChatGPT大規模言語モデル(LLM)の普及を目の当たりにしてください。

AIの重要な用途のひとつは、戦術指揮官が司令部で受信するバラバラのインテリジェンスのフィードをふるいにかけることだ。キリングスワース(Killingsworth)は、大量の異種データを分類することは、AIが特に適していると感じている。「戦術レベルのオペレーターにとっては、ビデオ・フィード、画像、押収文書などのコンテンツを配信することで、インテリジェンス収集能力を強化できる可能性がある」とゾンマー(Sommer)は言う。このインテリジェンス・コンテンツは、「その後、AI技術を使って、より上位の組織で行われるインテリジェンス活動に反映させることができる」。指揮官は、ヒューマン・インテリジェンス、画像インテリジェンス、通信インテリジェンスなど、さまざまな情報源から情報を受け取る。

入ってくるインテリジェンスのほとんどが、彼らの任務とは関係のない周辺的なものである可能性も十分にあるが、関連する情報を見つけ、解釈し、それを必要とする人々に配布しなければならない。そのためにAIが役割を果たすかもしれない。例えば、一見何の関連性もなさそうなバラバラの情報を、アルゴリズムによって分類し、優先順位をつけることができる。それにもかかわらず、一見つながりのないように見えるこれらのデータも、収束させれば意味を持つようになるかもしれない。AIを使ってインテリジェンスの取り扱いを支援することは、ターゲッティングの絞り込みを支援し、おそらくは精度を向上させるという相応の利益をもたらす可能性がある。特定のターゲットを認識するアルゴリズムを訓練することで、狙うところ(aimpoints)を検出して位置を特定するペースを加速できるかもしれない。

情報を選別し理解するこの能力は、指揮官の戦術的意思決定を支援することができる。「AIがもたらす自動化によって、戦術オペレーターの状況認識を向上させることができる」とゾンマー(Sommer)は指摘した。「例えば、コンピュータ・ビジョンを使って変化監視タスクを行うインテリジェンス・システムは、敵のアセットの存在(または欠如)を特定し、これを共通インテリジェンス画像(common intelligence picture)に追加することができる。そして、この共通作戦画像(common operating picture)を現場のユーザーと共有することができる。人工知能は、関連するインテリジェンス・監視・偵察(ISR)アセットを特定し、タスクを課すことができる。アセットが任務を遂行すれば、エフェクターにタスクを与えてターゲットと交戦させることができる。AIは、戦闘被害評価(battle damage assessment)のプロセスを支援するために使用することもできる。

各種リスク要因

しかし、重要な注意点は、戦闘管理システムに組み込まれたAIアプローチは万能薬ではないということだ。現状の技術では、せいぜい意思決定を補助するツールに過ぎない。

公平を期すため、キリングスワース(Killingsworth)のような専門家は、指揮・統制系統においてAIが人間に取って代わるとは考えていない。「戦闘の遂行と実施の最終的な責任は依然として人間にある」。とはいえ、AI対応の戦術的戦闘管理システムは、「現場の指揮官が、より多くの情報を手元で得られるようになる」可能性がある。この情報には、「多くの潜在的な決心がどのように展開されるかについての最高のAIの予測が含まれる」可能性がある。キル・チェーン(kill chain)におけるAIの関与に関する疑問は、より複雑かもしれない。「AI対応システム(AI-enabled system)が、人間の介入なしにターゲットの特定と交戦の全サイクルを完了するという意味で、このようなシステムは『致死性』ではない」とレイノルズ(Reynolds)は指摘する。

しかし、「戦闘管理システム(BMS)の出力に基づき、指揮官が可能または望ましいと認識するものを形作るという意味で、選択のパラメーターとその選択のスピードを形作るという意味で、致死性である」。レイノルズ(Reynolds)は、これらの要因が「意味のある(そして)適切な人間による統制を希薄なものにする」危険性があると続ける。このことは、このようなシステムが戦争法(laws of war)とどのように整合するかという問題と同様に、深刻な倫理的問題を提起する」。

戦場における無人システムの普及とAIへの依存の高まりは、この後者の技術への軍事的依存に関する議論をさらに形作るに違いない。また、異なるAIを基盤とするシステムが互いにどのように相互作用するかという問題もある。 写真:米陸軍 |

むしろ、この議論は「我々は、AI対応の決心を、人間が統制しているか否かの二元論で考えるのではなく、人間の主体性の要素がAIシステムに委ねられる、複雑で展開的なプロセスで考えるべきである」と再考される必要があるかもしれない。デイビス(Davis)は、ローレンス・リバモア国立研究所(LLNL)、米エネルギー省、米国家核安全保障局、米国防総省(DoD)、その他の米政府機関の見解を代表するものではないことを強調し、個人的な見解を述べた。「戦場におけるAIの到達目標であるスピードは、外交を含む戦争における他の重要な考慮事項と矛盾する可能性がある。より速いことが常に良いとは限らない」。

とはいえ、紛争の坩堝(るつぼ)におけるAIと人間の相互作用に関する疑問については、楽観的である。「指揮官が生死の決断を自動化されたシステムに委ねてしまうのではないかという懸念は根拠のないものだ。どの指揮官も、そのような権限への介入を望んでいない。それが本来のガードレールなのだ」。

また、AI対応の戦闘管理システムへの過度の依存に注意することも重要だ。キリングスワース(Killingsworth)は、「(現場の指揮官は)こうした非常に強力なツールに依存するようになる危険性があり、それがなければ決心の麻痺(decision paralysis)に直面する可能性がある」と警告する。AIがもたらす属性が利用できない場合でも、指揮官が戦い、勝利する方法を知っていることが不可欠になる。広く普及させるためには、軍がこの技術を確実に信頼することが不可欠である:「EpiSciは、オペレーターの信頼に重点を置きながら、すべてのAIが拘束され、保証されていることを確認するために多大な労力を費やしています…オペレーターに受け入れられなければ、これらのツールはどれも国家防衛の強化には役立ちません」。

戦術的戦闘管理システム(tactical BMS)におけるAIアプローチがどこまで支援できるかは、アルゴリズムの訓練に使われるデータの質に左右される。我々の脳が学習するのは、我々の人生が一連の経験として記憶され、それが我々の振舞いに影響を与えるからである。軍隊、特にNATOの軍隊は、ありがたいことに比較的めったに戦争をしない。これは平和のためには良いことだが、その結果アルゴリズムの訓練に使える作戦や戦術のデータが乏しくなる。アルゴリズムの訓練に使われるデータは信頼できるものでなければならない。「ガーベッジ・イン、ガーベッジ・アウト(GIGO)」※は、よく引用されるコンピューティングの定説だが、今でも大いに当てはまる。

※ 《garbage in garbage out》コンピューターによる分析やシミュレーションにおいて、入力する情報が正しくないと、出力される情報も正しくないということ。特に、データマイニングや機械学習などの分野で、無意味なデータをいくら入力しても、無意味な結果しか得られないという意味合いで用いられる。(引用:www.weblio.jp/)

この問題に付随して、データそのものが、将来の戦争においてクラウゼヴィッツ学派(Clausewitzian)の重心(centre of gravity)になるかもしれないという事実がある。「データは壊れやすい」とデイビス(Davis)は警告する。「サイバー戦争の新時代の一部は、敵対者のデータ・ベースを攻撃することだ。これは実は簡単なことで、期待された利益をすべて台無しにしてしまう可能性がある」。この問題に取り組む一つの方法は、データを分散化することだとデイビス(Davis)は勧めた。「特に中央集権化されたデータ・ベースや決心支援に過度に依存すると、大惨事につながりかねない」。データの保存場所と保存方法に冗長性を組み込むことが最も重要だ。

レイノルズ(Reynolds)が観察したように、戦争は本質的に複雑な問題である。「AI対応のシステムは、複雑で偶発的な状況に対処する任務を負ったとき、パフォーマンスが低下する傾向がある」。レイノルズ(Reynolds)は、自動運転車が要求される能力レベルに到達するまでに抱えていた問題を引き合いに出した。「戦争は本質的に複雑であり、敵対者を欺くための絶え間ない努力を伴うため、AI対応の戦闘管理システムがそのような状況にどのように対処するかについては、深刻な疑問が残る」。AIを基盤とする指揮・統制アーキテクチャは、ハッキングやサイバー攻撃に対しても安全でなければならないのは自明の理だ。「技術的な妨害という点では、データは敵対者によって「毒を入れられ(poisoned)」たり、改ざんされたりする可能性があり、センシング・システムは妨害される可能性がある。そして、戦闘管理システム(BMS)の予測および決心支援能力に影響を与える可能性がある」。

「非技術的な例として、AI対応システム(AI-enabled system)にとって予期せぬ物理環境の変化は、物体(戦車や敵戦闘員など)の分類を誤らせる可能性がある」。ウクライナ東部の荒れ地が示すように、戦争は物理的環境を劇的に変化させる習性がある。コストの問題も大いに関係している。「コンピューティング・パワーとメモリは、AI技術の発展を制限する可能性がある」とゾンマー(Sommer)は警告した。「軍隊は、より高性能のコンピュータを前方に送り出し、簡単に損傷したり、破壊されたり、敵の手に渡る可能性のある環境に送り込むために、どれだけの投資ができるかを判断しなければならない」。AIを動かす技術は多くの電力を必要とする。とはいえ、航空機や船舶は、人工知能技術をネイティブにホストするための物理的な空間と発電能力を有している」とゾンマー(Sommer)は付け加えた。

それは今起こっていることだ

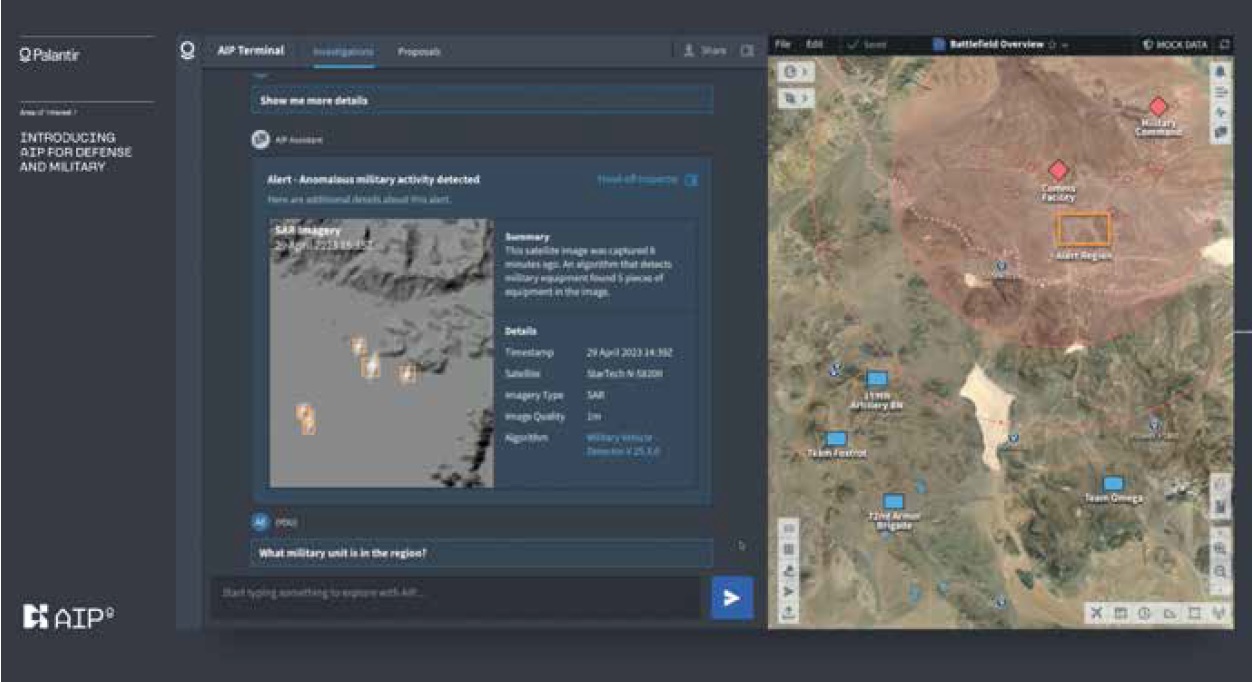

AI対応の戦闘管理システムが間もなく登場する。「我々は、軍隊がこれらのツールを徐々に採用しているのを見ており、それは今日始まっている」とキリングスワース(Killingsworth)は言う。産業界も注目している。2023年、Palantir社は大規模言語モデル(LLM)アプローチを採用した「防衛のための人工知能プラットフォーム(Artificial Intelligence Platform for Defence)」を発表した。大規模な言語モデルは、AIの文脈で語られることが多い。簡単に言えば、AIソフトウェアを使ってテキストを生成するということだ。人気のあるChatGPTソフトウェアは大規模言語モデル(LLM)アプローチを使っている。指揮官はこのソフトウェアに質問し、発生した、あるいは発生しつつある事象に基づく行動方針(courses of action)の指針を受け取ることができる。

Palantirの防衛用人工知能プラットフォームは2023年に発表され、大規模な言語モデル・アーキテクチャに依拠して指揮・統制を支援する。 写真:Palantir社 |

担当者は、関連するインテリジェンスや情報を要求することができる。また、具体的な行動方針(courses of action)を命令することもでき、それをソフトウェアが文書命令に変換することもできる。この記事の作成中、Palantir社に問い合わせたが、数回の問い合わせには応じなかった。

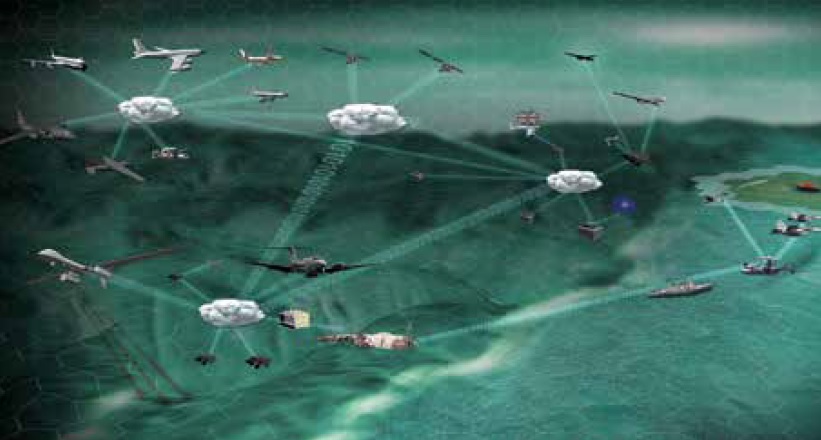

さらに、米国防総省の統合全ドメイン指揮・統制(JADC2)アーキテクチャは、実質的なAIコンテンツを持つことになる。統合全ドメイン指揮・統制(JADC2)は、米国防総省のマルチドメイン作戦(MDO)ドクトリンの考え方の現れである。マルチドメイン作戦(MDO)は、すべての軍事アセット(要員、プラットフォーム、兵器、センサー、能力、基地)を、あらゆる戦争レベルにおいて、部隊間および部隊内で接続することを提唱している。マルチドメイン作戦(MDO)の到達目標は、敵対者よりも速いペースでより質の高い意思決定を行うことである。マルチドメイン作戦(MDO)は、目を見張るようなレベルのデータの収集、解釈、普及に重きを置く。データ量が人間の認知を圧倒する可能性があるため、AIアプローチがこれらのプロセスに内在することは避けられない。同様に、Scale AI社は米陸軍と協力し、同社のDonovan 大規模言語モデル(LLM)が米陸軍の統合全ドメイン指揮・統制(JADC2)への貢献をどのように支援できるかを検討している。

米軍におけるマルチドメイン作戦(Multi Domain Operations)の考え方の前進、そしてその統合全ドメイン指揮・統制(JADC2)の現れとして、データの効率的な収集、処理、移動が重視されている。統合全ドメイン指揮・統制(JADC2)がAIの活用を重視するのは必然である。 クレジット:L3Harris社 |

技術が進歩する一方で、戦術的なドメインでAIを吸収するための準備が必要となる。ゾンマー(Sommer)は、「AIが戦術的な場所で採用されるようになるには、軍隊の文化的、ドクトリン上、場合によっては社会・政治的な変化が必要になるだろう」と述べ、さらに、「時間が経過し、これらの技術の一部が民間の世界で主流になれば、軍隊組織におけるデジタル・ネイティブの役割は、AIや機械学習(ML)技術の採用を容易にするかもしれない」と付け加えた。

最終的にデイビス(Davis)は、「批判的な評価、限界の広範な理解、広範なテストとシミュレーションによって、軍の指導者たちは、部隊や国民、任務を危険にさらすことなく、AIツールから必要なものを引き出すことができるはずだ」と考えている。