米国におけるAIの倫理原則の現状

先日、「2024年までにAIが戦闘機ドッグファイトが試される。」で、AIに関する倫理的制限の話題が取り上げられました。

その中で、JAIC(統合AIセンター)の米国でのAIの倫理に関する取り組みや同盟国への支援について紹介されていましたが、10月20日のユーラシアレビューの中で、「軍事におけるAIガバナンス– AI倫理原則」に関する記事が出ていましたので紹介したいと思います。米国における軍のAIの倫理原則のフレームワークとその実装について理解の一助となるのではないかと思います。(黒豆柴)

国防総省は、倫理的な人工知能のために5つの原則を公式に採用。出典:DODグラフィック

AI Governance In Military Affairs – AI Ethical Principles:Implementing US Military’s Framework – Analysis October 29, 2020 RSIS

軍事におけるAIガバナンス– AI倫理原則:米軍のフレームワークの実装–分析

米国国防総省(DoD)は、人工知能(AI)における倫理原則の開発と採用に関して、ここ数か月で実際の進歩を遂げた。

現在の課題は、AI倫理を国防総省の無数のコンポーネントとミッション全体で制度化する方法のフレームワークを確立することである。By Megan Lamberth*

米国国防総省は、倫理的で信頼性が高く、安全なAIの開発と展開を確実にするための最善の方法を決定する初期段階にある。

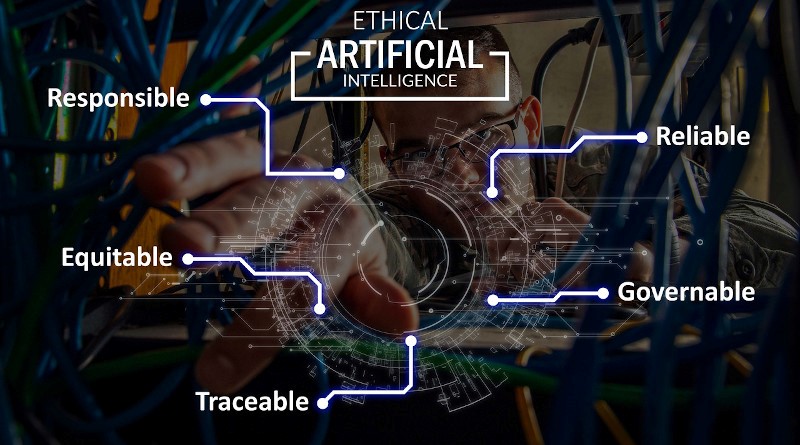

今年の初め、国防総省 は、AI対応システムの開発、採用、および使用の基準とすること目的とした一連のAI倫理原則を正式に採用した 。

DoD、特に統合AIセンター(JAIC)は、これらの原則をDoD担当者向けの実用的なガイダンスに修正している途上にある。

原則が意味のある永続的なものであるためには、JAICは追加の権限とリソースを必要としており、国防総省もまた、安全・安心で、倫理的なAIを確保するという課題にも取り組んでいる同盟国やパートナーと協力して取り組む必要がある。

他の人は米国の経験から何を学ぶことができるのか?

Adopting and Implementing AI PrinciplesAI原則の採用と実装

過去2年間、国防総省はAI採用の基礎を築くためにいくつかの措置を講じてきた。

2018年6月、国防総省 は兵役を含む部門全体のAI活動の同期機関として機能するJAICを設立した。8か月後、国防総省の最初の AI戦略 は、「弾力性、堅牢性、信頼性、安全性」の AIシステムの開発を要求し、 AI機能が「合法かつ倫理的な方法」で使用されることを保証する一連の原則を明確にすることを公約した 。

これらの倫理原則を策定する任務は、 技術専門家と民間産業リーダーからなる連邦諮問委員会で防衛部門の高級幹部に新興技術について助言する防衛イノベーション委員会 (DIB)に委ねられた。DIBは2019年10月に提案されたAI原則を発表し 、3か月後、DODはそれらを正式に採用した。端的に言うと、国防省 は次のようなAIシステムを開発して展開することを明言している。

- 責任。AI対応システムの「開発、展開、使用」の責任は、使用者である人間。

- 公平。DoDは、AI機能の「意図しない偏向を最小限に抑える」ように機能。

- 追跡可能。AIシステムのライフサイクルに関与するDoD担当者は、テクノロジー、その開発、およびその運用上の使用について「適切に理解」。

- 信頼できる。DoDは、AIシステムに「明示的で明確な用途」がありこれらのシステムが運用ライフサイクル全体を通じてテストと評価を受けることを保証する。

- 統制可能。AIシステムには、「意図しない結果を検出して回避する」機能と 「意図しない動作を示す展開済みシステムを解除または非アクティブ化する」機能がある。

*****AI倫理原則に関して、2020年2月25日のDOD Newsから引用***********

統合AIセンターの所長である空軍中将のジャック・シャナハン氏は、AIは強力な新興技術であり、文化、社会、そして最終的には戦闘さえも急速に変革していると述べた。

「それがポジティブな方法であるかネガティブな方法であるかは、採用と使用に対する私たちのアプローチにもとづくものだ。」と彼は語った。

「AIに対応した未来の軍を構築する事によって、戦争の複雑さと速度は変化するだろう。

我々は、自由で開かれた社会という私たちの国の価値観を反映するAI倫理原則を採用することは、アメリカの人々と制服を着た私たちの男性と女性のおかげだ。」

シャナハン氏もまた信じ、国防総省の指導者たちも、AIを最初に習得する国は、将来の戦場で勝つ国になると信じていると述べた。

「私たちはまた、AIの原則を首尾よく実行している国が、長年にわたってAIをリードすると信じている」と彼は言った。 「米軍はまさにそれをするつもりだ。」

***********************************************************************

Signal to US Allies 米国の同盟国へのシグナル

これらのAI原則の採用は 、国防省にとって注目に値する成功であった。

この原則は、国防総省が新しいAIの能力を採用するだけでなく、 それらの能力をどう使うかにも関心を持っていることを民間のテクノロジー企業や米国の同盟国に知らせる ものとなるものだ。

原則は広範である程度曖昧だが、これは意図的に行われたものである。

AIは、戦闘、指揮統制、ロジスティクス、メンテナンスなど、さまざまなユースケースを備えた実現テクノロジーである。

原則は、防衛部門全体ですでに広く使用されているAIアプリケーションと同様に将来のAIの使用を網羅するのに十分に広範囲である必要があった。

JAICの元ディレクターとして、シャナハン中将 は次のように説明した。「技術は進歩し、技術は進化する。私たちがやりたかった最後のことは、その部門に手枷をかけて、できることとできないことを言うことであった。」

JAICの現在の仕事は、これらの原則を、さまざまなアプリケーションに対応するのに十分な順応性がありながら、部門全体で意味のあるアクションを促進するのに十分具体的な実用的なガイダンスに変換することだ。J

JAICは、倫理的なAIのフレームワークと、 AIに取り組むすべての国防総省職員向けの「共有語彙」の開発に取り組んでいる2つの新しいイニシアチブを開始し た。

AI分科会 -AIの国防総省の幅広いワーキンググループの一部は-AIの取得と実装のために必要な倫理的枠組みを確立するために取り組んで国防総省の代表で構成される他分野にまたがるグループ。

AIチャンピオンズパイロット、AIにおける倫理の重要性に関して国防総省の担当者を訓練するために設計されたプログラムは、部門の倫理原則をAIシステムのライフサイクル全体に現実的に記述する方法を模索している。

Way Forward 今後の方向性

これらの重要な進歩にもかかわらず、JAICは、AI倫理に関するDODのガイダンスを実装しようとする試みにおいて依然として逆風に直面している。

JAICの喫緊の課題は、その権限及びリソースの現状レベルと広範な委任権限との不均衡を調和することである。

2019年12月からのRAND報告書 として、JAICは、「指令又は予算権限を持っておらず、これは、国防総省全体のAIアクティビティを同期及び調整して変更を規定する力を著しく制限する。」

JAICは、その使命を果たすために、-予算と人員の両方の-追加のリソースと、より大きな権限を必要としている。JAICのスタッフは2018年の設立以来着実に増加しているが、部門のAIの統合を適切に管理するには、JAICのスタッフを増やし続ける必要があるのだ。

JAICには、 新しいAI機能の取得とテストのプロセスを促進するために独自の調達権限も必要である。

会計年度2021年国防権限法(NDAA)ドラフトの下院版は、当局の変化を求めている。同じ NDAAドラフト は、国防副長官の直下にJAICを配置することにより、JAICを指揮系統の上位に移動することになる。

これは、JAICに部門全体の可視性を高めるために必要な変更である。

Bringing in Like-Minded Countries 同意見の国々の参加を

AICの権限とリソースを増やすことに加えて、国防総省は、AI開発に倫理を組み込むという同様の課題に取り組んでいる多くの同盟国およびパートナー国からの賛同と参加を求め続ける必要がある。

JAIC とシンガポールの防衛科学技術庁(DSTA)との パートナーシップは、AI開発におけるコラボレーションのメリットを示している。昨年、両国は、災害と人道支援のためのAIの使用を中心とした数日間の一連の交換を開催した 。

今年の初めに、JAICは最初の「防衛のためのAIパートナーシップ」を 発表した。-これは、 同意見の国々の参加を求め、AIシステムに倫理を組み込むためのベストプラクティスを共有することを目的としたイニシアチブ である。この種のパートナーシップは、特に米国と中国の間の地政学的競争が進展し続ける中で重要である。JAICとDSTAのパートナーシップや防衛のためのAIパートナーシップのような緊密なコラボレーションにより、 軍隊間の相互運用性の向上、グローバルなデータセットへのアクセス、責任あるAIの開発と配備を確実にするためのベストプラクティスの共有が可能になる 。

最終的に、これらのパートナーシップは、米国およびインド太平洋地域の同盟国だけでなく、世界中の国々の安全に利益をもたらす事となるのだ。

Challenges Ahead 今後の課題

実施プロセスを妨げる障害は一夜にして解決されない。

防衛部門は、新しい機能の開発とフィールド化を継続しながら、AIシステムのセキュリティと信頼性を確保する方法を引き続き検討することとなる。

同時に、同僚のマルタン・ラッサーと私が今年初めに 書いたように、DoDは、AI機能を採用して広く展開する能力を阻害する制度的および官僚的な障壁を克服しなければならないだろう。

今のところJAICの使命は、倫理とAIに関する国防総省のガイダンスが明確で広く理解されていることを確認することで、これにより、ロジスティクスから戦闘、インテリジェンスまでのDoD担当者は、倫理AIとは何かだけでなく、それをどのように適用すべきかを知ることができる。

Source: This article was originally published in RSIS Commentary, a publication of RSIS.

RSIS

RSIS Commentaries are intended to provide timely and, where appropriate, policy relevant background and analysis of contemporary developments. The views of the author/s are their own and do not represent the official position of the S.Rajaratnam School of International Studies (RSIS), NTU, which produces the Commentaries